Por: AP, DPA, AFP y Redacción La Hora

Geoffrey Hinton, un galardonado científico informático conocido como “el padrino de la Inteligencia Artificial (IA)”, está teniendo serias reservas sobre el fruto de su trabajo.

Hinton ayudó a crear tecnologías de IA’s que han sido determinantes para una nueva generación de chatbots como ChatGPT. Pero en entrevistas recientes, reveló que renunció a un alto cargo en Google, específicamente para compartir sus inquietudes de que el desarrollo irrestricto de la IA plantea serios riesgos para la humanidad.

“Repentinamente he cambiado mis puntos de vista sobre si estas cosas serán más inteligentes que nosotros”, declaró en entrevista con MIT Technology Review.

“Creo que están ahora muy cerca de serlo y que en el futuro serán mucho más inteligentes que nosotros… ¿cómo vamos a sobrevivir a eso?”, añadió.

Hinton no es el único que tiene esas preocupaciones. Poco después de que la firma OpenAI lanzó en marzo su nueva versión de chatbot GPT-4, más de 1.000 científicos firmaron una carta pidiendo una pausa de seis meses en el desarrollo de la IA porque plantea “profundos riesgos a la sociedad y a la humanidad”.

LA INTELIGENCIA DEPENDE DE LAS REDES NEURONALES

Nuestros cerebros son capaces de resolver ecuaciones matemáticas, conducir automóviles y seguir la trama de una serie de televisión gracias a su talento inherente de almacenar, organizar información y producir soluciones para problemas espinosos. Lo que hace eso posible son los aproximadamente 86 mil millones de neuronas que tenemos dentro del cráneo y, lo que es más importante, los 100 billones de conexiones que esas neuronas forjan entre sí.

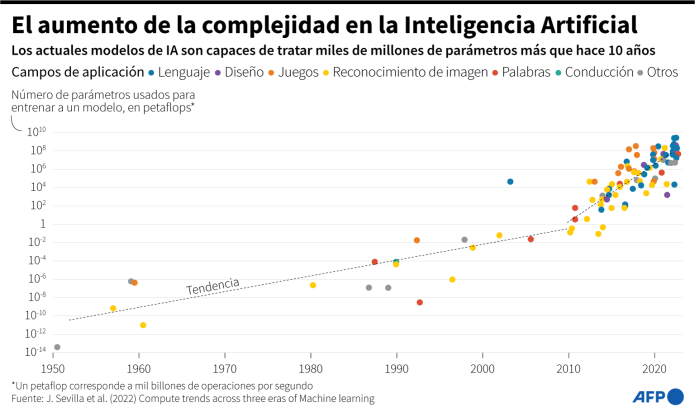

En comparación, la tecnología que fundamenta a ChatGPT cuenta con entre 500.000 y un billón de conexiones, dijo Hinton en la entrevista. Aunque ello parece menos que la capacidad del cerebro humano, Hinton señala que GPT-4, el modelo de IA más reciente de OpenAI, sabe “cientos de veces más” de lo que sabe un ser humano. Es posible, indica, que tenga “un algoritmo de aprendizaje mucho mejor” y por lo tanto sea más eficiente en tareas cognitivas.

PROBABLEMENTE YA ES MÁS INTELIGENTE QUE NOSOTROS

Los expertos desde hace tiempo han sostenido que las redes neuronales artificiales demoran mucho más en absorber y aplicar nuevos conocimientos que las personas, ya que para entrenarlas se requiere gran cantidad de energía e información.

Eso ya no es así, argumenta Hinton, destacando que sistemas como GPT-4 son capaces de aprender sumamente rápido una vez que son entrenados por los investigadores. Eso no es muy distinto a la manera en que, digamos, un físico profesional es capaz de analizar resultados de un experimento mucho más rápido que un estudiante de secundaria común.

Ello lleva a Hinton a concluir que los sistemas de IA probablemente ya son más inteligentes que nosotros. No sólo pueden captar cosas más rápido, sino que pueden compartir copias de su conocimiento entre ellos casi instantáneamente.

“Es un tipo de inteligencia totalmente distinta”, dice Hinton. “Un nuevo y mejor tipo de inteligencia”.

IMPACTO DE LAS IA’s EN EL MERCADO LABORAL

Algunos expertos, como Ignasi Aranda, jefe de Nube de Application Modernization y María Vázquez, directora de Soluciones en España de Microsoft, abordaron que la introducción de tecnologías como la IA, tendría un impacto negativo en el mercado laboral, pero señalaron que se estarían generando nuevos empleos, y que la IA puede optimizar los procesos para que los empleados se centren en tareas más creativas. Sin embargo, también advierten que las organizaciones deben transformarse y prepararse para un cambio en las carreras y que la eficiencia generada por la tecnología, debe ser invertida en la eficacia de su uso.

GUERRAS Y RUMORES

¿Qué podrían hacer sistemas de IA más inteligentes que los humanos? Una posibilidad espeluznante es que individuos, grupos o Estados malintencionados los usen para alcanzar sus propósitos.

Hinton está particularmente preocupado por la posibilidad de que estas herramientas sean usadas para manipular resultados electorales o iniciar guerras.

La desinformación electoral propagada por chatbots, por ejemplo, podría ser la nueva versión de la desinformación electoral que anteriormente se propagaba por Facebook u otras redes sociales.

Y eso podría ser apenas el comienzo. “No duden ni por un instante que Putin estaría dispuesto a usar robots inteligentes para matar ucranianos”, dijo Hinton en el artículo. “Él no vacilará”.

UNA FALTA DE SOLUCIONES

Lo que nadie sabe es cómo se podría evitar que una potencia como Rusia use la IA para subyugar a sus vecinos o incluso a sus propios ciudadanos.

Hinton sugiere que se podría necesitar un acuerdo similar a la Convención Internacional contra las Armas Químicas de 1997, para elaborar normas que rijan el uso de la IA.

Sin embargo, cabe destacar que esa convención no impidió lo que, según investigadores, fueron probablemente ataques del gobierno sirio con cloro y con el neurotóxico sarín contra civiles en 2017 y 2018 durante la guerra civil en ese país.

DEMOCRATIZACIÓN DE LAS TECNOLOGÍAS

Vázquez y David Pereira, jefe de Datos e Inteligencia de NTT DATA, mencionan que las empresas tecnológicas como Opera, Nvidia, Google, Adobe y Microsoft han incorporado IA generativa en sus programas y servicios recientemente, lo que algunos han considerado como una evolución natural.

Estos servicios ya existían, como Github y Bing, pero ahora tienen nuevas capacidades gracias a la IA. La democratización es un concepto clave aquí. El acceso a estas soluciones propuestas por Microsoft facilita muchos procesos a la hora de implementar IA a gran escala.

Aunque todavía se crean modelos personalizados para los clientes, el foco ha cambiado hacia un acompañamiento formativo. Las empresas están aprendiendo sobre las herramientas disponibles para ellos.

CASA BLANCA SE REÚNE CON GIGANTES DE LA IA POR REGULACIONES

Esta semana, la vicepresidenta de los Estados Unidos, Kamala Harris, convocó a los directivos de Google, Microsoft, OpenAI y Anthropic para trazar estrategias sobre el impacto de la inteligencia artificial en la sociedad.

Harris afirmó que el sector privado tiene el deber ético, moral y legal de asegurar la seguridad de sus productos, ya que la IA puede aumentar las amenazas a la seguridad, reducir los derechos humanos y la privacidad y socavar la confianza pública en la democracia.

Mientras que el presidente Joe Biden también advirtió a los empresarios sobre los riesgos de la IA e insistió en leyes con límites más estrictos en el sector tecnológico.

El deslumbrante éxito desde fines del año pasado de ChatGPT, la interfaz de IA generativa de OpenAI, fue el punto de partida para una carrera hacia sistemas cada vez más intuitivos y eficientes. La Casa Blanca anunció nuevas inversiones en la investigación sobre IA y nuevos métodos de evaluación de los sistemas actuales.

Los gigantes de la IA no niegan que existan riesgos, pero temen que se asfixie la innovación por leyes demasiado restrictivas.

Datos incluidos en esta nota:

Experto advierte sobre riesgos de la inteligencia artificial -AP-

Portaltic.- La IA generativa como copiloto del equipo humano y una regulación definida para respaldar su adopción en las empresas -DPA-

La Casa Blanca habla con gigantes de la IA con fines regulatorios -AFP-